Qwen3-VL

💜 Qwen Chat | 🤗 Hugging Face | 🤖 ModelScope | 📑 博客 | 📚 Cookbooks | 📑 论文

🖥️ 演示 | 💬 微信 | 🫨 Discord | 📑 API | 🖥️ PAI-DSW

## 简介

欢迎了解 Qwen3-VL —— Qwen 系列迄今为止最强大的视觉语言模型。

这一代模型实现了全方位的升级:更优的文本理解与生成、更深的视觉感知与推理、更长的上下文长度、更强的空间与视频动态理解能力,以及更强大的智能体交互能力。

提供从边缘到云端的 Dense 和 MoE 架构,并配有 Instruct 版和推理增强的 Thinking 版,以满足灵活、按需的部署需求。

#### 主要增强:

* **视觉智能体**:可操作 PC/移动端 GUI——识别界面元素、理解功能、调用工具、完成任务。

* **视觉编码增强**:根据图像/视频生成 Draw.io/HTML/CSS/JS 代码。

* **高级空间感知**:判断物体位置、视角和遮挡关系;提供更强的 2D 定位能力,并支持 3D 定位,用于空间推理和具身智能。

* **长上下文与视频理解**:原生支持 256K 上下文,可扩展至 1M;能处理书籍和数小时长的视频,具备完整的回忆和秒级索引能力。

* **增强的多模态推理**:在 STEM/数学领域表现出色——擅长因果分析和基于证据的逻辑回答。

* **升级的视觉识别**:更广泛、更高质量的预训练使其能够“识别万物”——名人、动漫、产品、地标、动植物等。

* **扩展的 OCR**:支持 32 种语言(之前为 10 种);在低光照、模糊和倾斜条件下表现稳健;对生僻字/古文字和专业术语处理更好;改进了长文档结构解析。

* **媲美纯文本 LLM 的文本理解**:无缝的文本-视觉融合,实现无损、统一的理解。

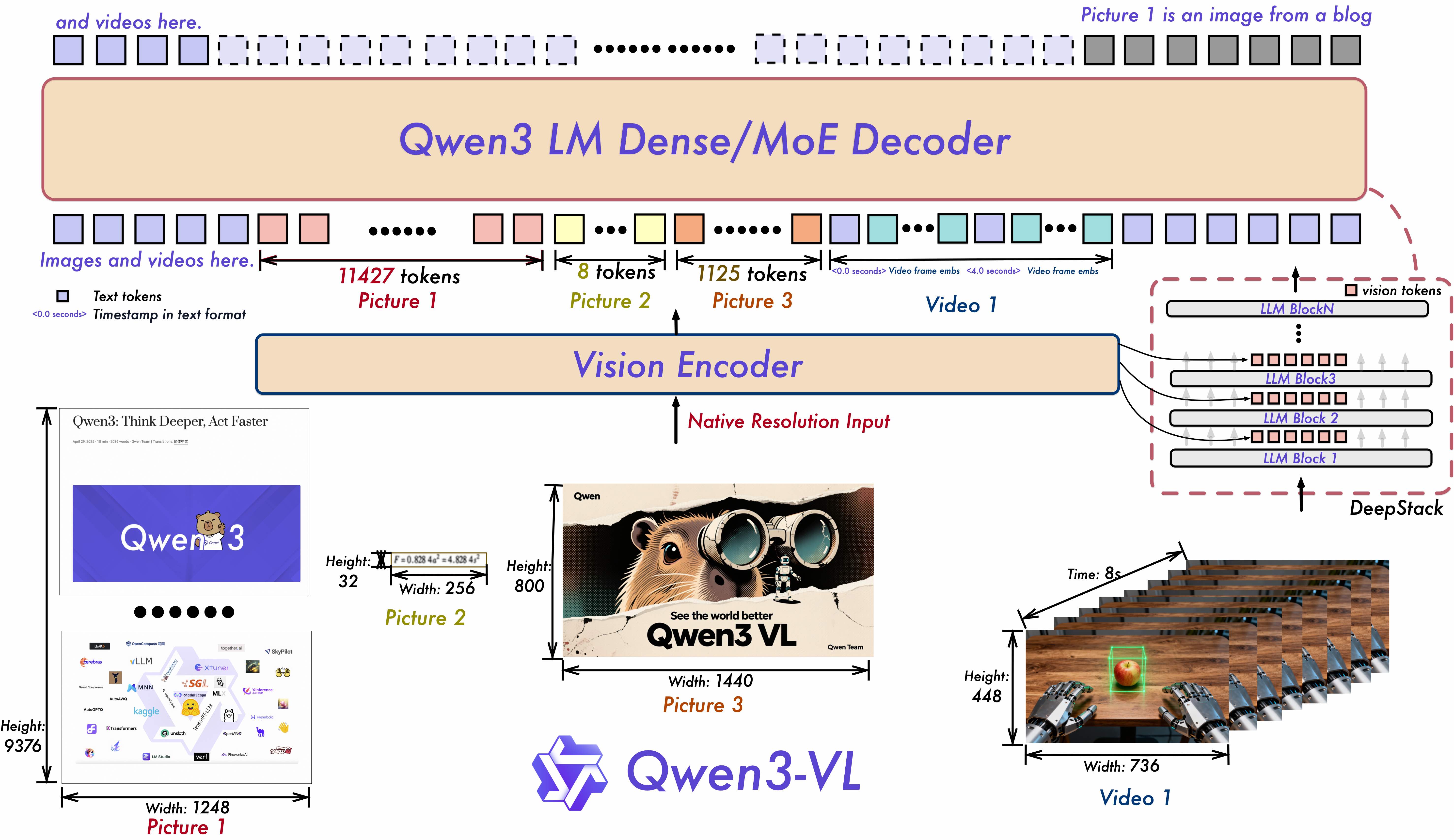

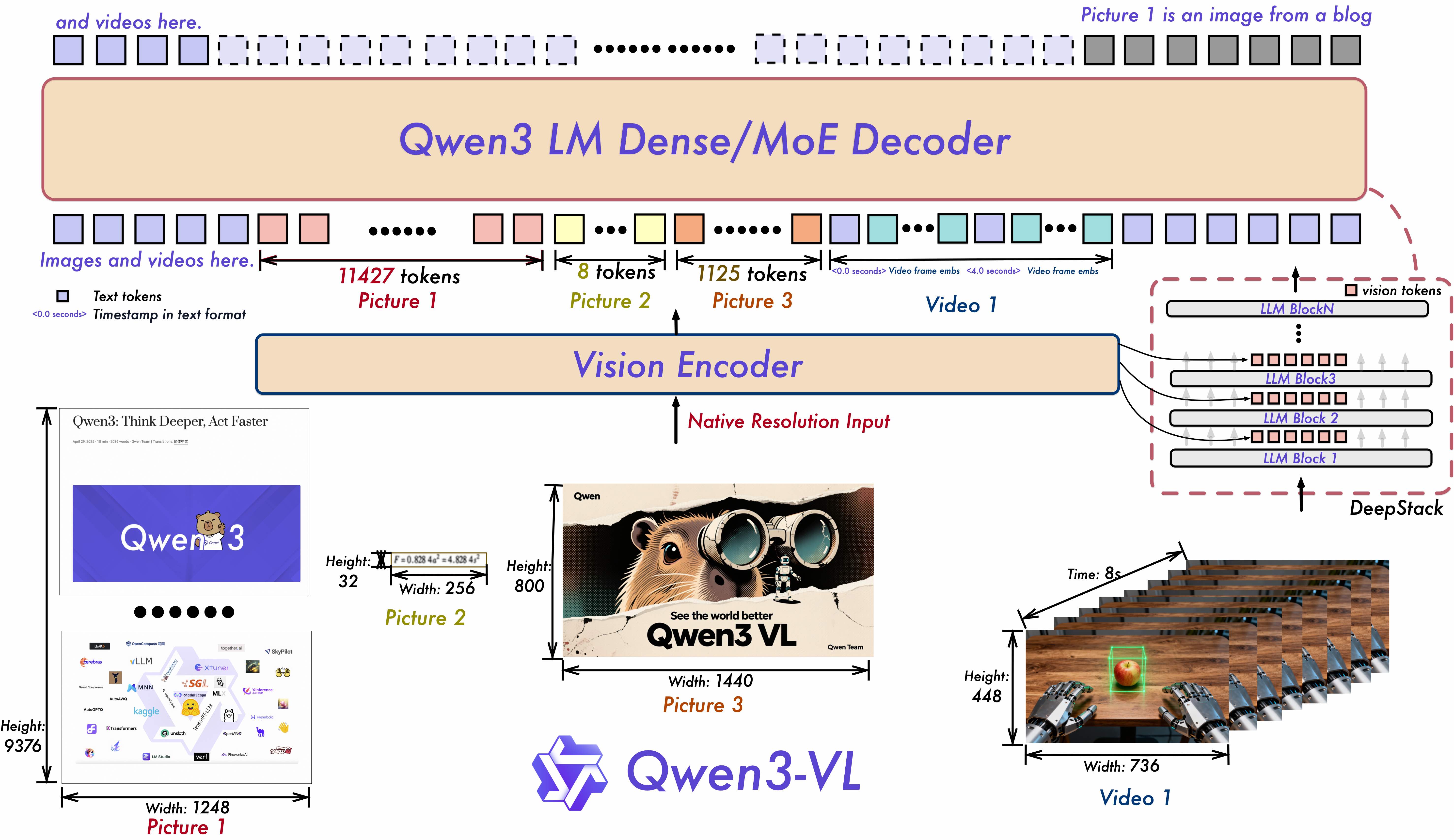

#### 模型架构更新:

1. **Interleaved-MRoPE**:通过鲁棒的位置编码,在时间、宽度和高度维度上进行全频率分配,增强了长序列视频推理能力。

2. **DeepStack**:融合多级 ViT 特征,以捕捉细粒度细节并锐化图像-文本对齐。

3. **文本-时间戳对齐**:超越 T-RoPE,实现精确的、基于时间戳的事件定位,以增强视频时序建模。

## 动态

* 2025.11.27:我们发布了 [**Qwen3-VL 论文**](https://arxiv.org/pdf/2511.21631),其中介绍了 Qwen3-VL 的许多技术细节,希望对大家有所帮助。

* 2025.10.21:我们发布了 **Qwen3-VL-2B** ([Instruct](https://huggingface.co/Qwen/Qwen3-VL-2B-Instruct)/[Thinking](https://huggingface.co/Qwen/Qwen3-VL-2B-Thinking)) 和 **Qwen3-VL-32B** ([Instruct](https://huggingface.co/Qwen/Qwen3-VL-32B-Instruct)/[Thinking](https://huggingface.co/Qwen/Qwen3-VL-32B-Thinking))。欢迎体验!

* 2025.10.15:我们发布了 **Qwen3-VL-4B** ([Instruct](https://huggingface.co/Qwen/Qwen3-VL-4B-Instruct)/[Thinking](https://huggingface.co/Qwen/Qwen3-VL-4B-Thinking)) 和 **Qwen3-VL-8B** ([Instruct](https://huggingface.co/Qwen/Qwen3-VL-8B-Instruct)/[Thinking](https://huggingface.co/Qwen/Qwen3-VL-8B-Thinking))。欢迎体验!

* 2025.10.4:我们发布了 [Qwen3-VL-30B-A3B-Instruct](https://huggingface.co/Qwen/Qwen3-VL-30B-A3B-Instruct) 和 [Qwen3-VL-30B-A3B-Thinking](https://huggingface.co/Qwen/Qwen3-VL-30B-A3B-Thinking)。同时,我们也发布了 Qwen3-VL 模型的 FP8 版本——可在我们的 [HuggingFace 集合](https://huggingface.co/collections/Qwen/qwen3-vl-68d2a7c1b8a8afce4ebd2dbe) 和 [ModelScope 集合](https://modelscope.cn/collections/Qwen3-VL-5c7a94c8cb144b) 中找到。

* 2025.09.23:我们发布了 [Qwen3-VL-235B-A22B-Instruct](https://huggingface.co/Qwen/Qwen3-VL-235B-A22B-Instruct) 和 [Qwen3-VL-235B-A22B-Thinking](https://huggingface.co/Qwen/Qwen3-VL-235B-A22B-Thinking)。更多详情,请查看我们的 [博客](https://qwen.ai/blog?id=99f0335c4ad9ff6153e517418d48535ab6d8afef&from=research.latest-advancements-list)!

* 2025.04.08:我们提供了用于微调 Qwen2-VL 和 Qwen2.5-VL 的 [代码](https://github.com/QwenLM/Qwen2.5-VL/tree/main/qwen-vl-finetune)。

* 2025.03.25:我们发布了 [Qwen2.5-VL-32B](https://huggingface.co/Qwen/Qwen2.5-VL-32B-Instruct)。它更智能,其回答也更符合人类偏好。更多详情,请查看我们的 [博客](https://qwenlm.github.io/blog/qwen2.5-vl-32b/)!

* 2025.02.20:我们发布了 [Qwen2.5-VL 技术报告](https://arxiv.org/abs/2502.13923)。同时,我们还发布了 Qwen2.5-VL 三个不同尺寸的 AWQ 量化模型:[3B](https://huggingface.co/Qwen/Qwen2.5-VL-3B-Instruct-AWQ)、[7B](https://huggingface.co/Qwen/Qwen2.5-VL-7B-Instruct-AWQ) 和 [72B](https://huggingface.co/Qwen/Qwen2.5-VL-72B-Instruct-AWQ)。

* 2025.01.28:我们发布了 [Qwen2.5-VL 系列](https://huggingface.co/Qwen)。更多详情,请查看我们的 [博客](https://qwenlm.github.io/blog/qwen2.5-vl/)!

* 2024.12.25:我们发布了 [QvQ-72B-Preview](https://huggingface.co/Qwen/QVQ-72B-Preview)。QvQ-72B-Preview 是一个实验性研究模型,专注于增强视觉推理能力。更多详情,请查看我们的 [博客](https://qwenlm.github.io/blog/qvq-72b-preview/)!

* 2024.09.19:指令调优的 [Qwen2-VL-72B 模型](https://huggingface.co/Qwen/Qwen2-VL-72B-Instruct) 及其量化版本 [[AWQ](https://huggingface.co/Qwen/Qwen2-VL-72B-Instruct-AWQ), [GPTQ-Int4](https://huggingface.co/Qwen/Qwen2-VL-72B-Instruct-GPTQ-Int4), [GPTQ-Int8](https://huggingface.co/Qwen/Qwen2-VL-72B-Instruct-GPTQ-Int8)] 现已可用。同时,我们也发布了 [Qwen2-VL 论文](https://arxiv.org/pdf/2409.12191)。

* 2024.08.30:我们发布了 [Qwen2-VL 系列](https://huggingface.co/collections/Qwen/qwen2-vl-66cee7455501d7126940800d)。2B 和 7B 模型现已可用,开源的 72B 模型即将推出。更多详情,请查看我们的 [博客](https://qwenlm.github.io/blog/qwen2-vl/)!

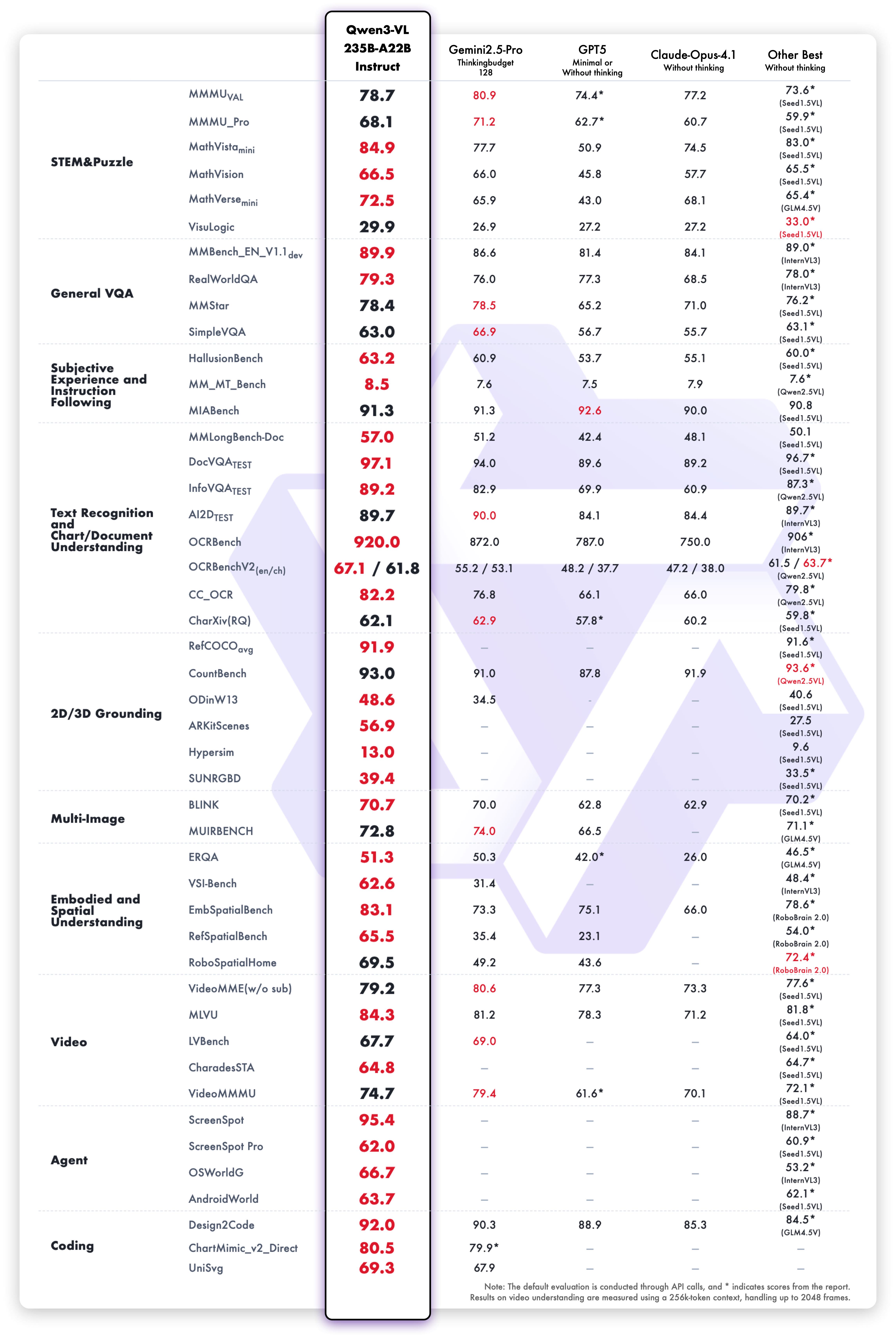

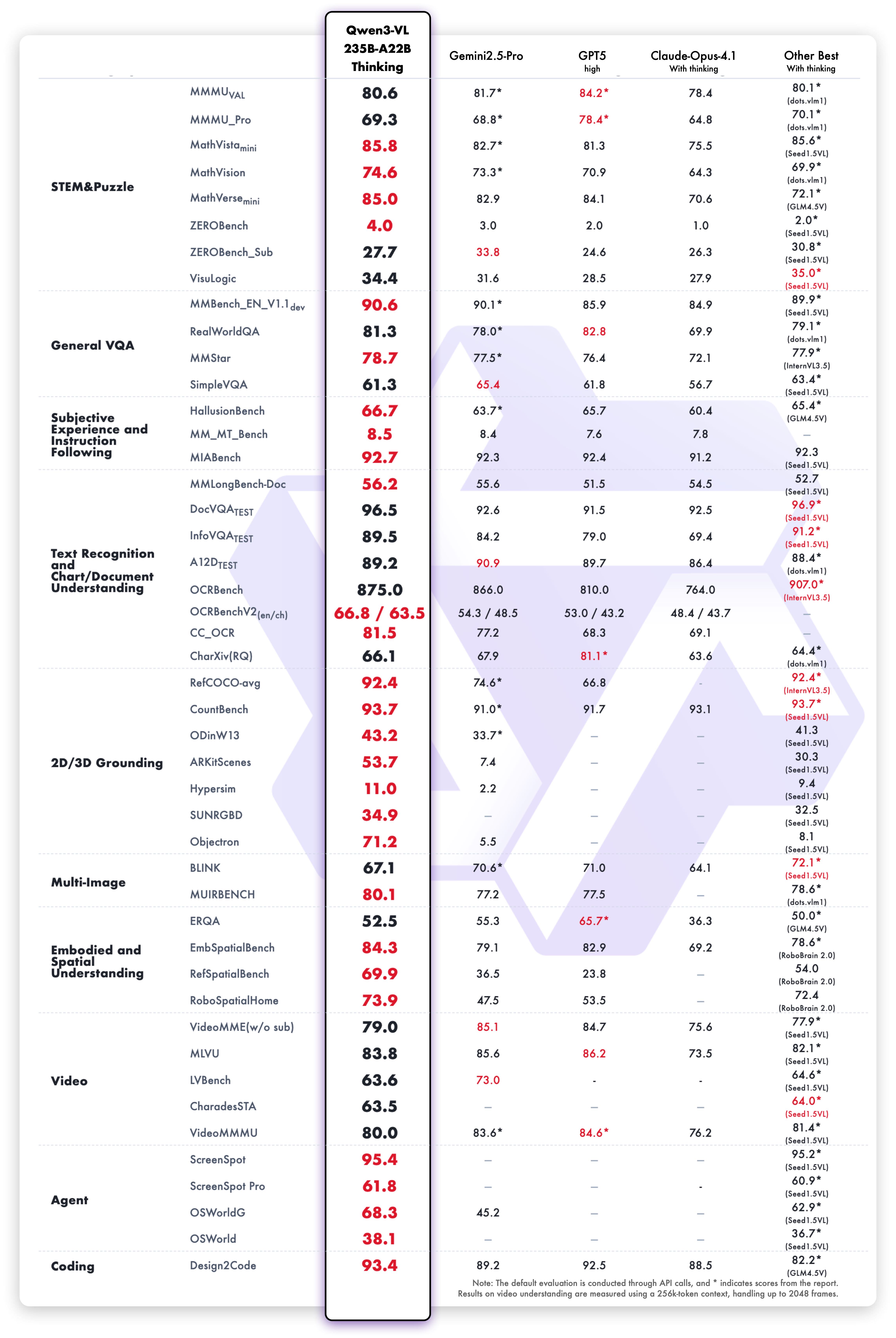

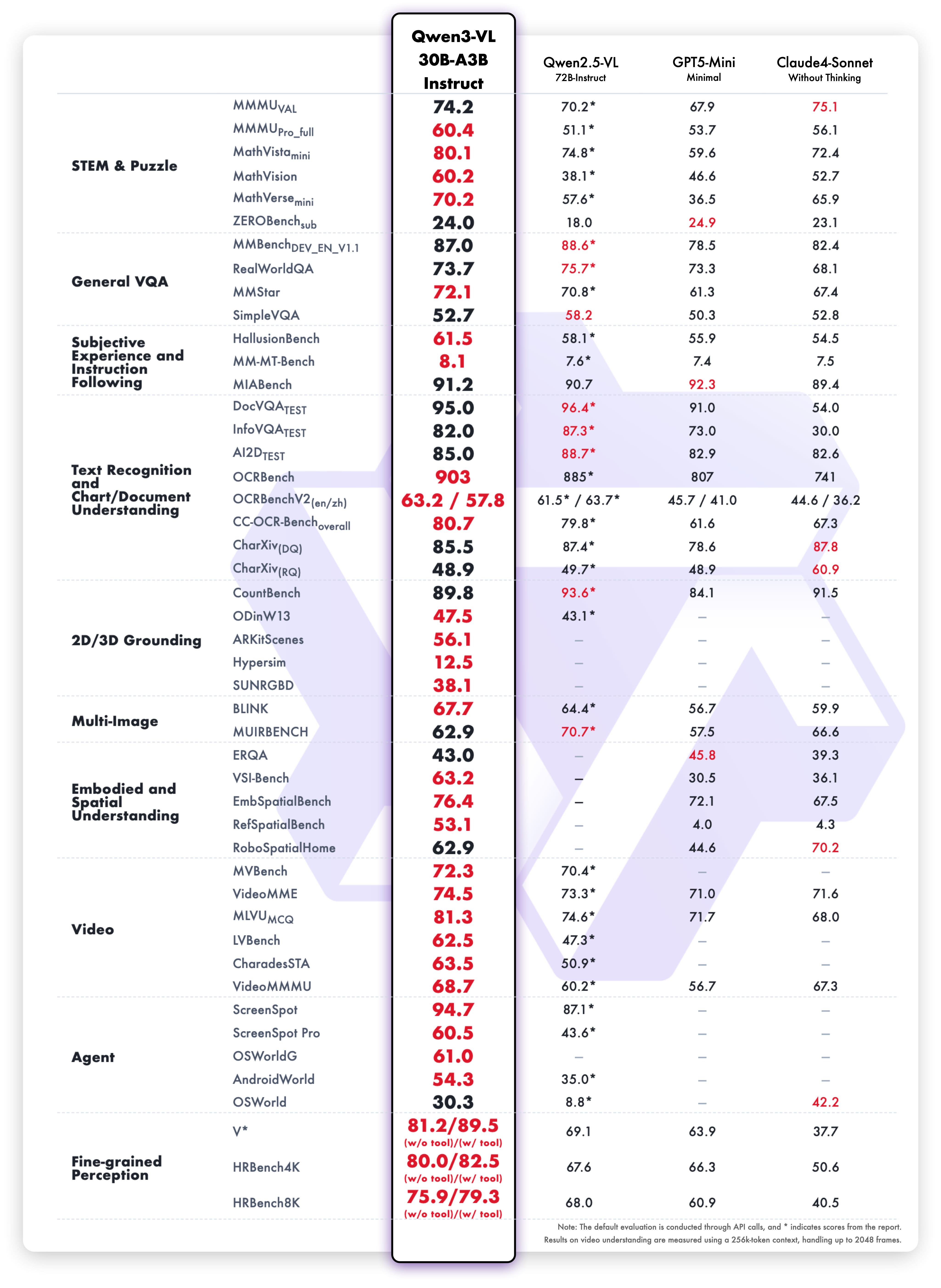

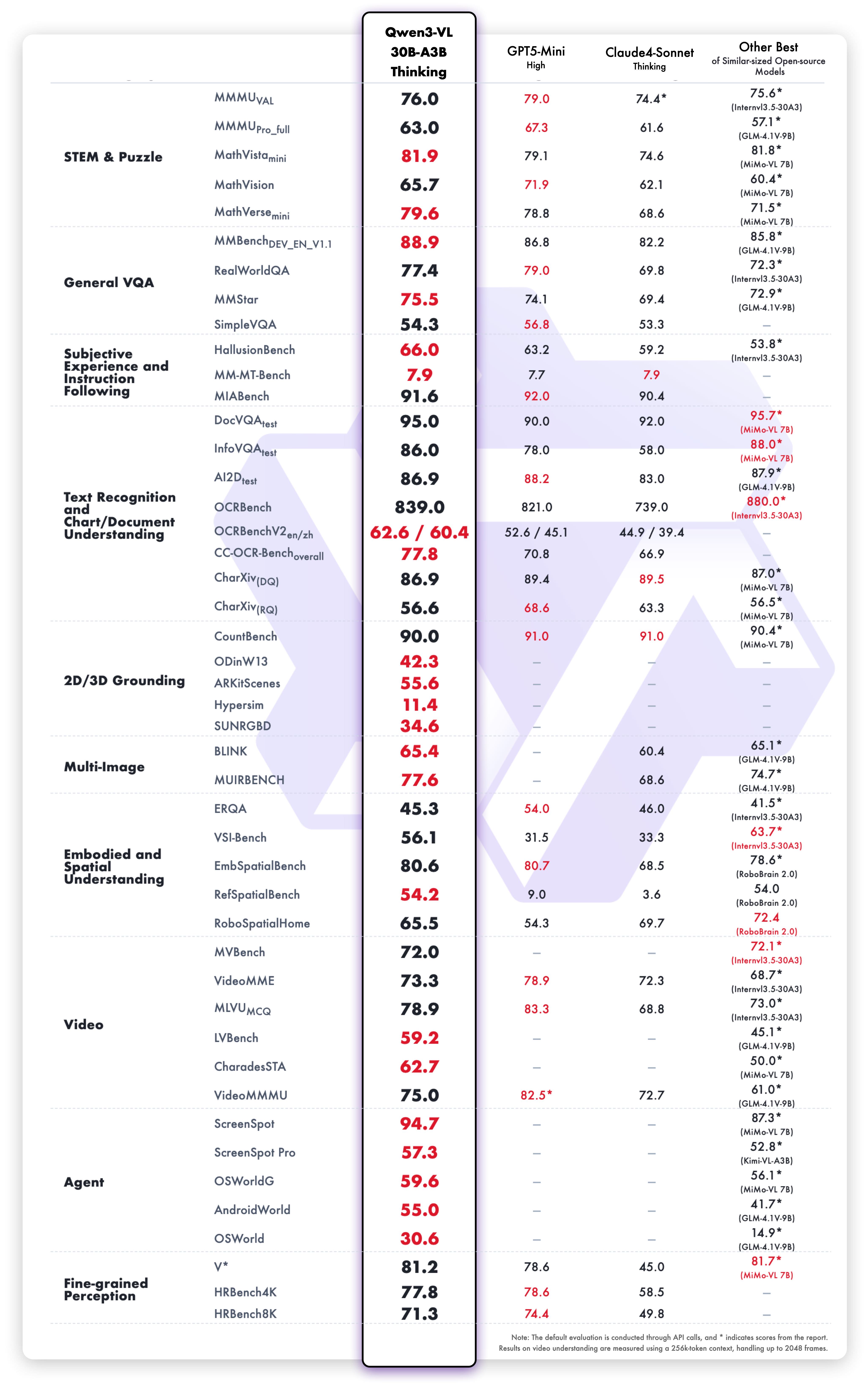

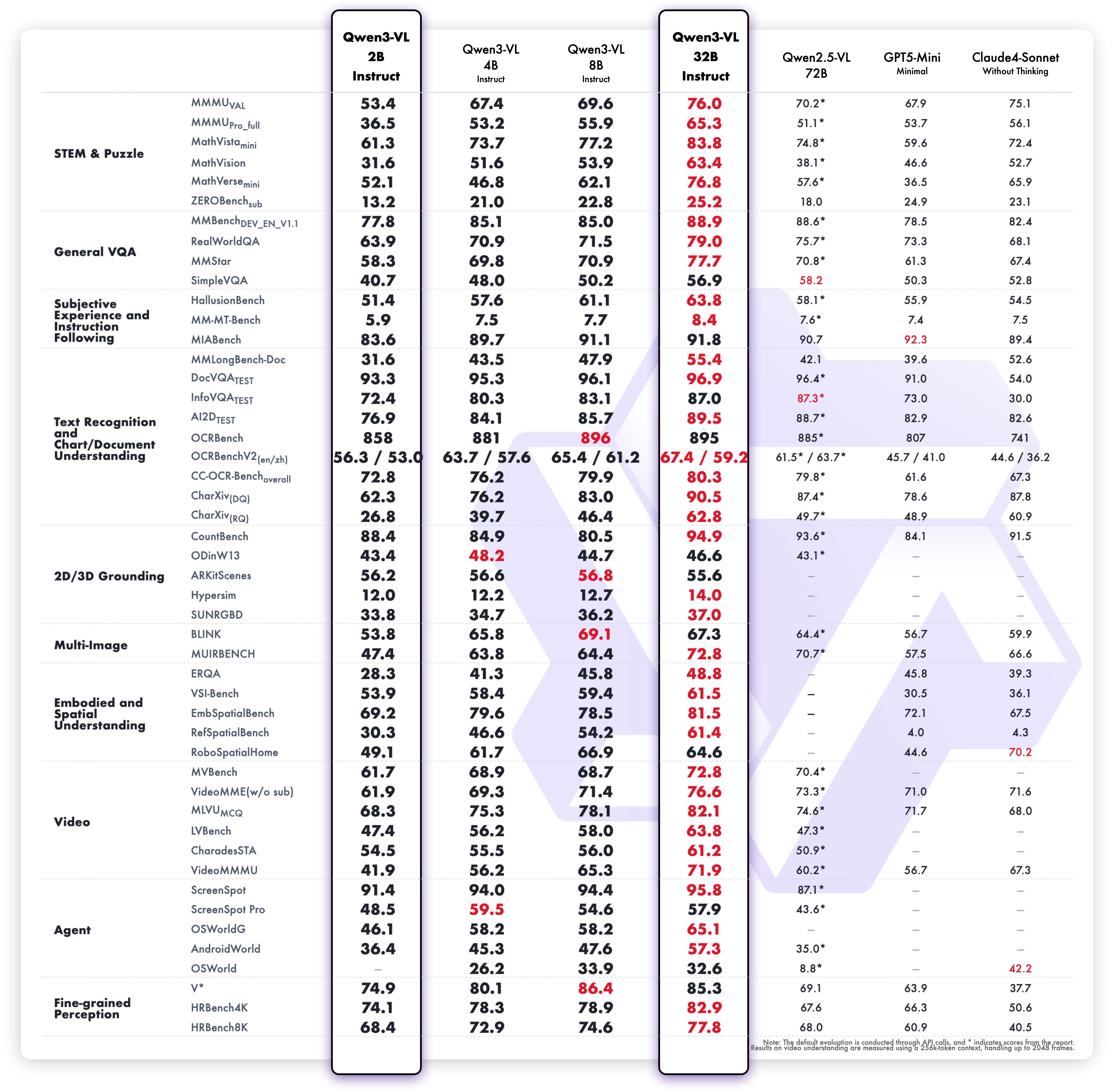

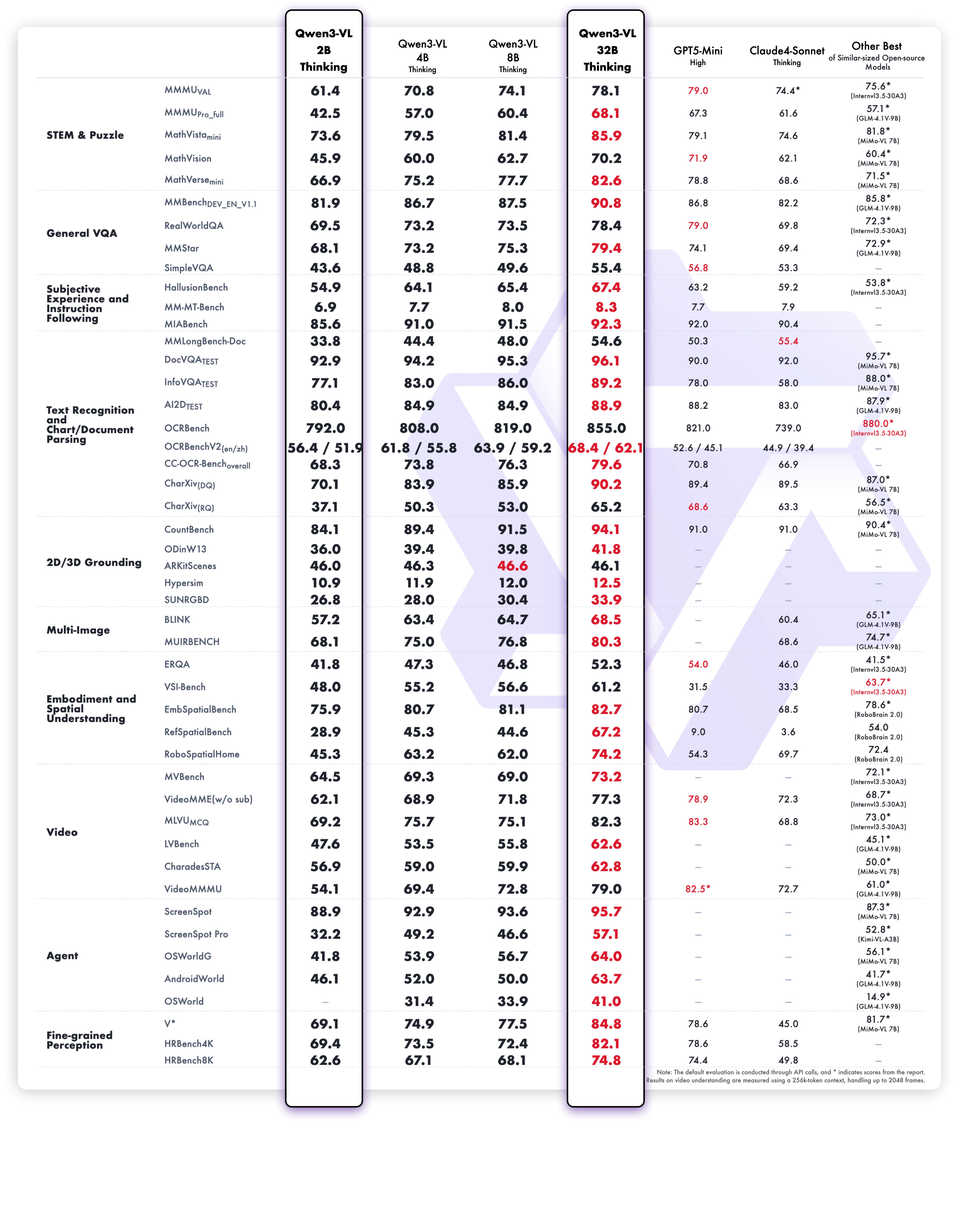

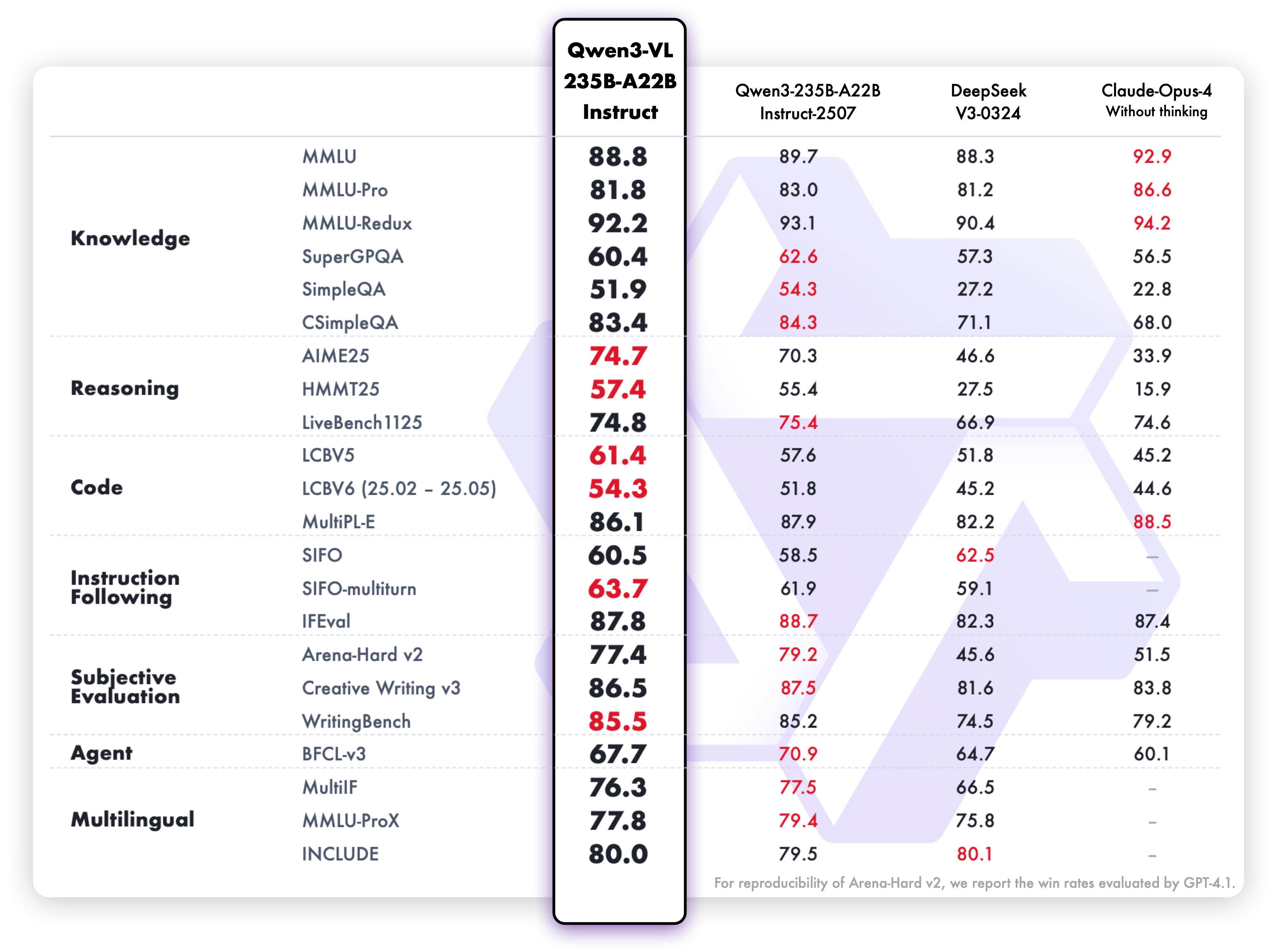

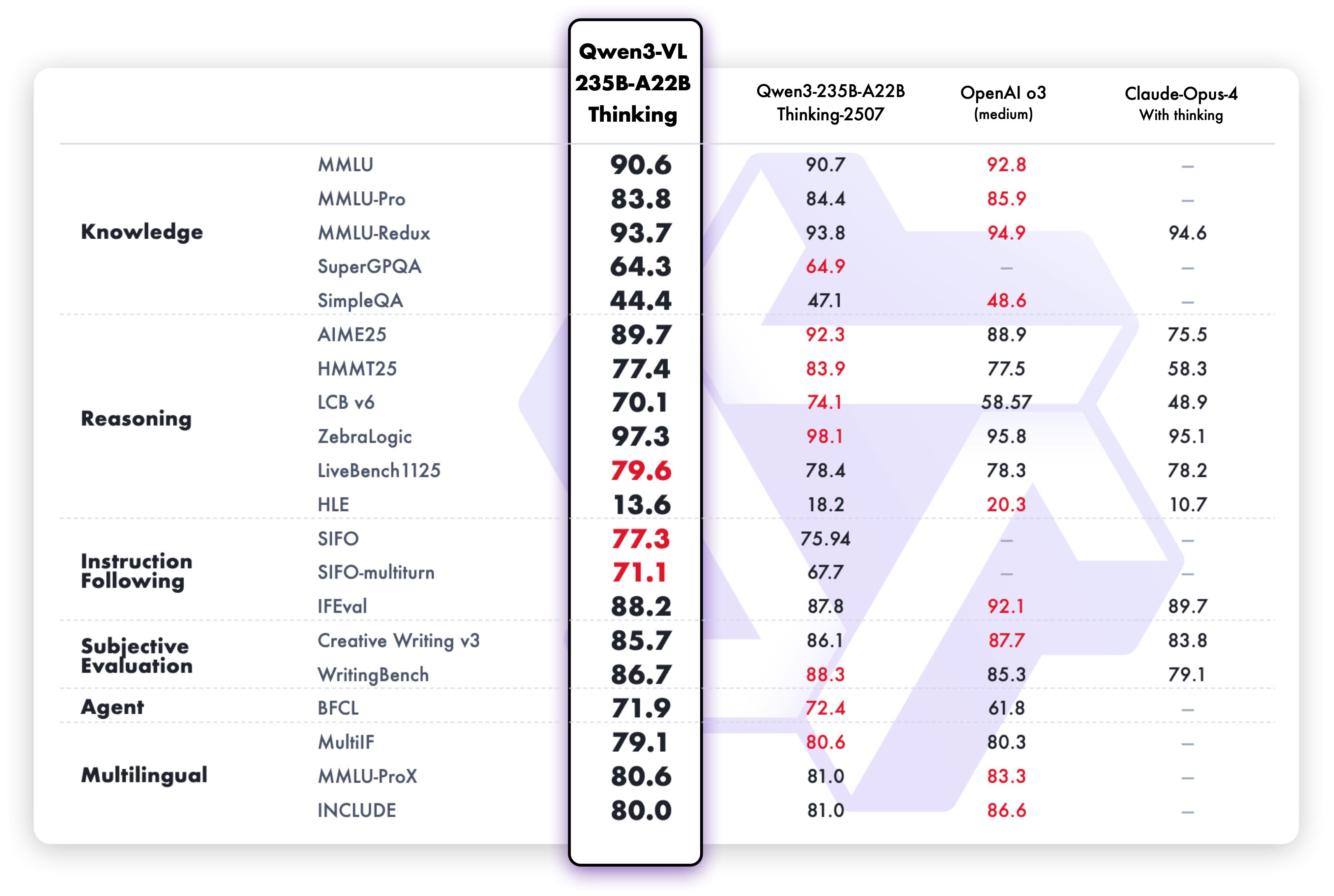

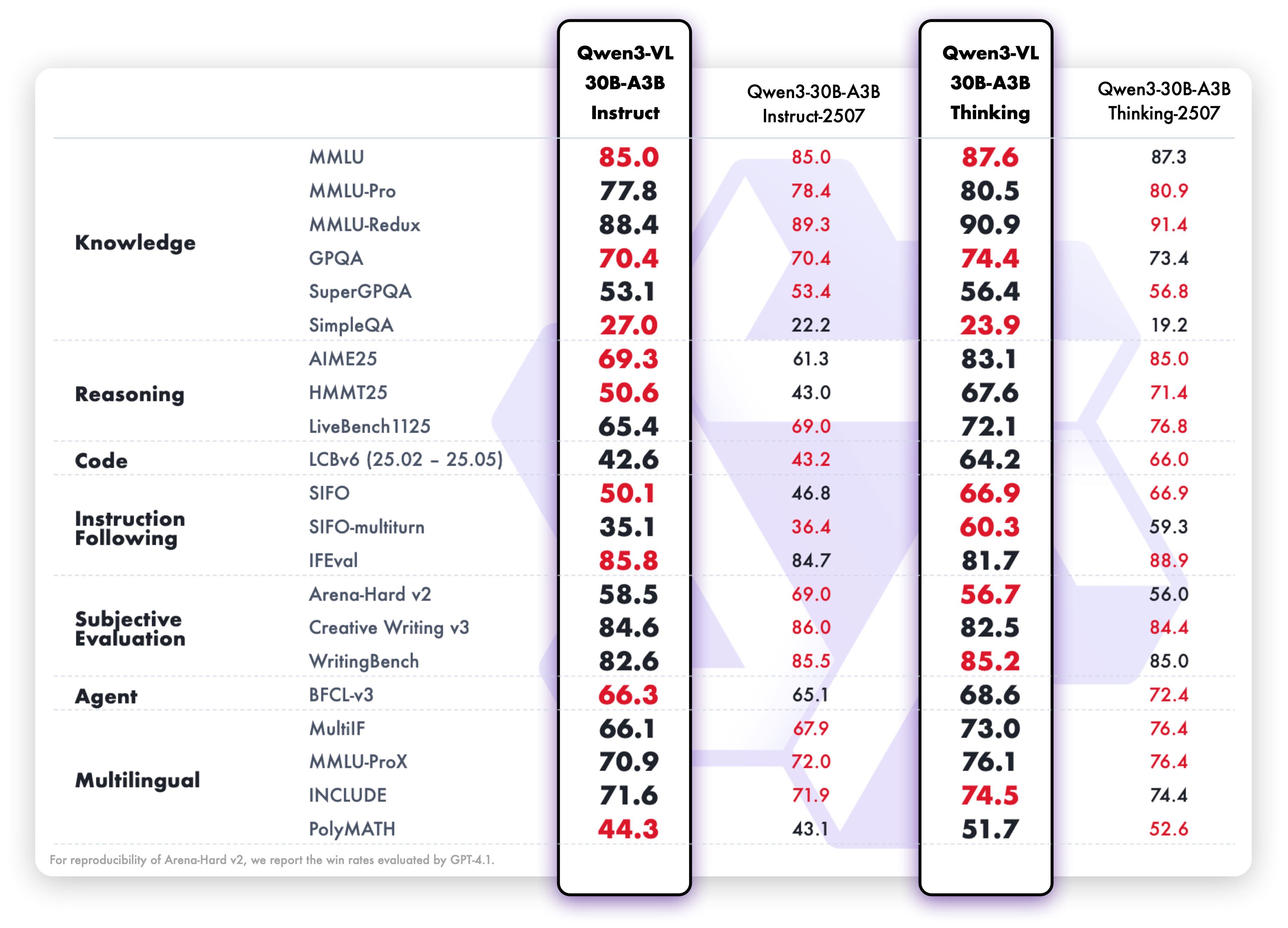

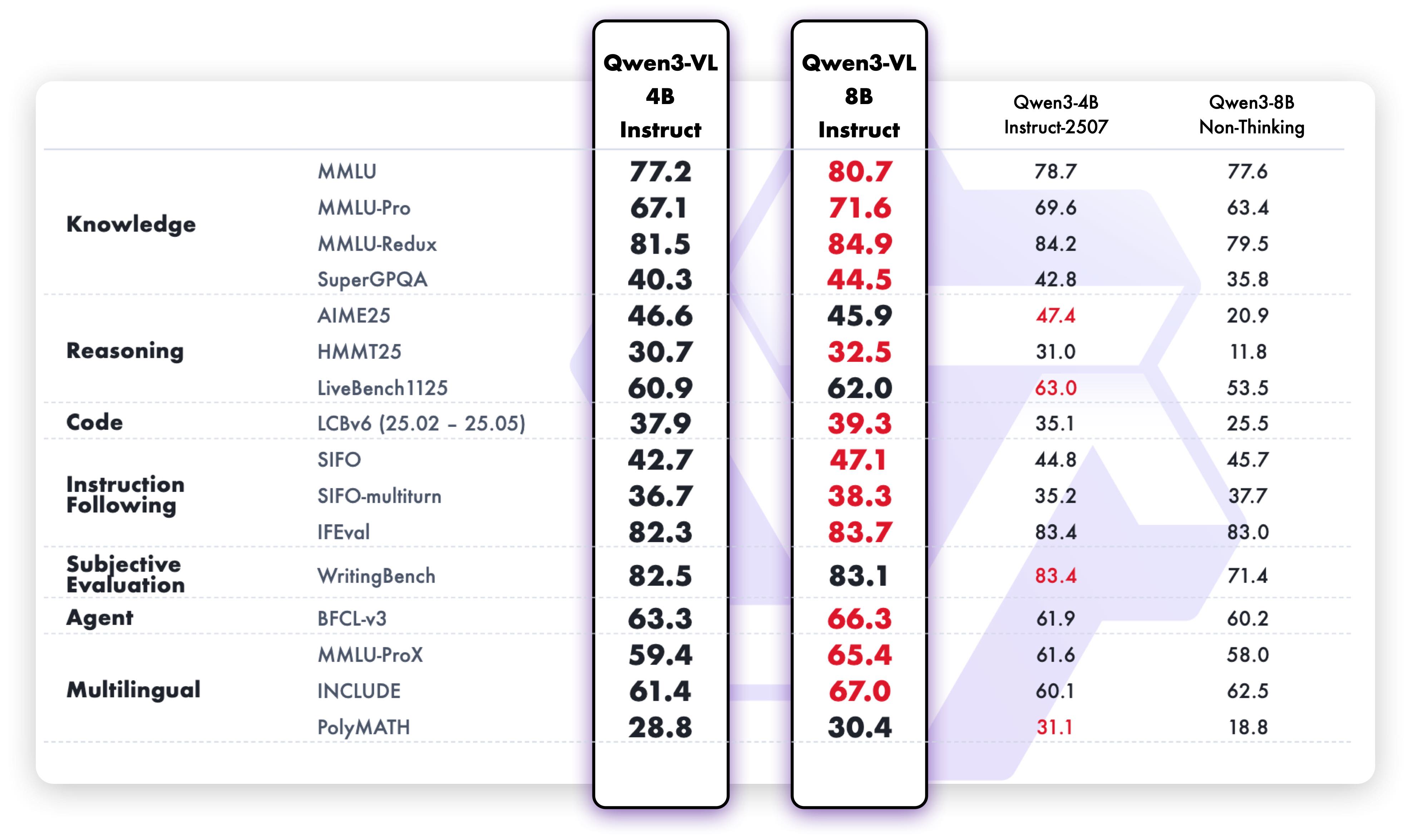

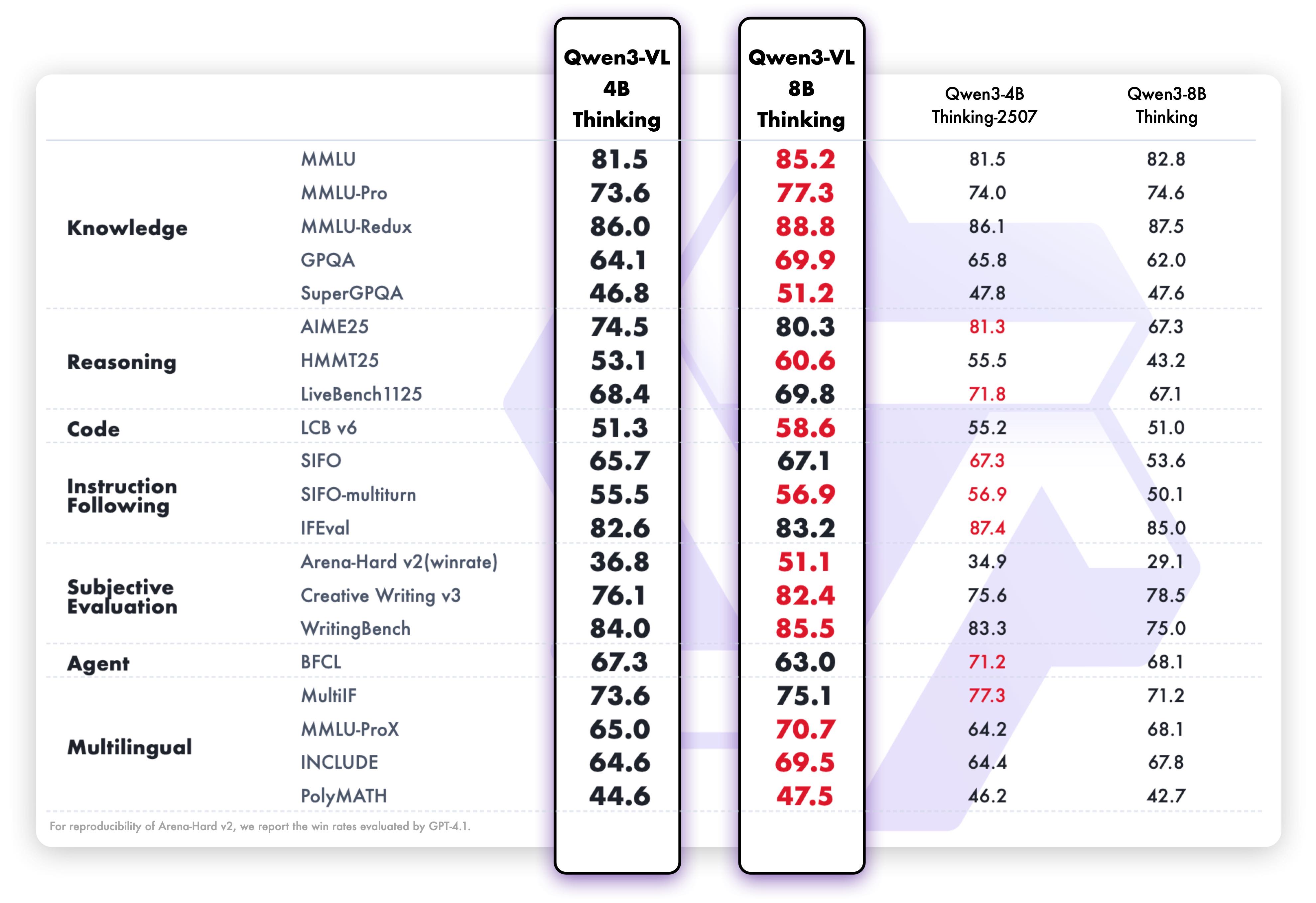

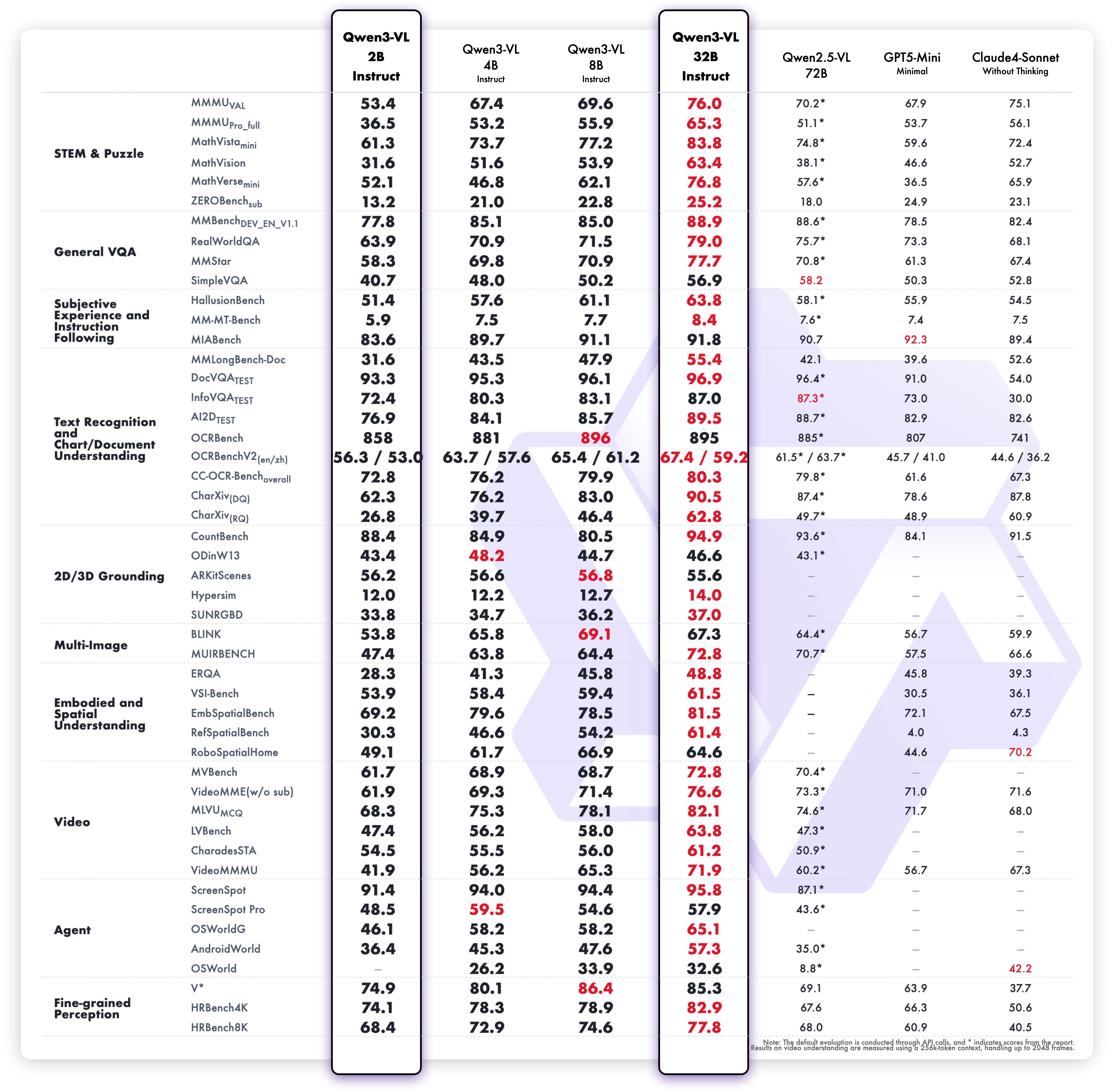

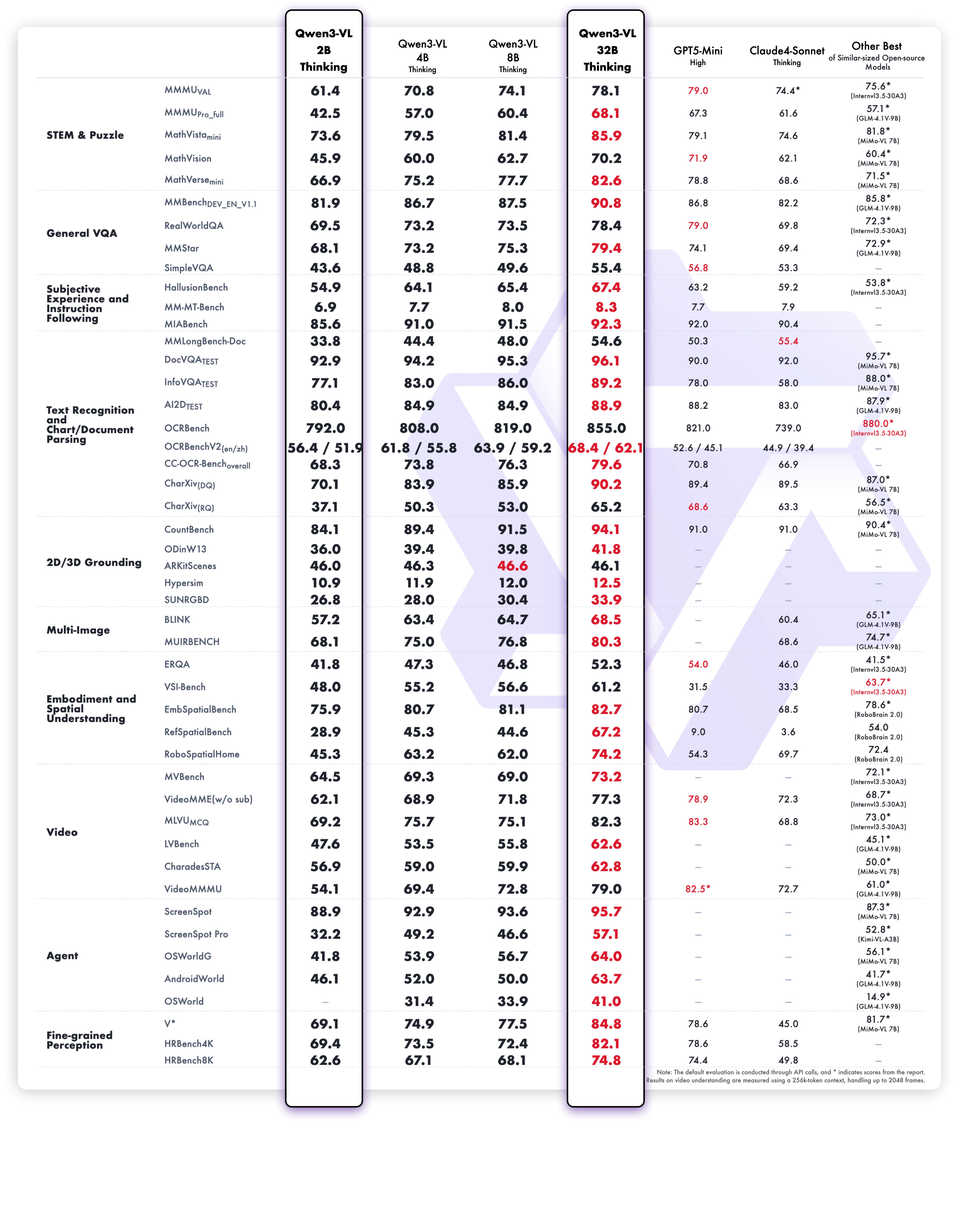

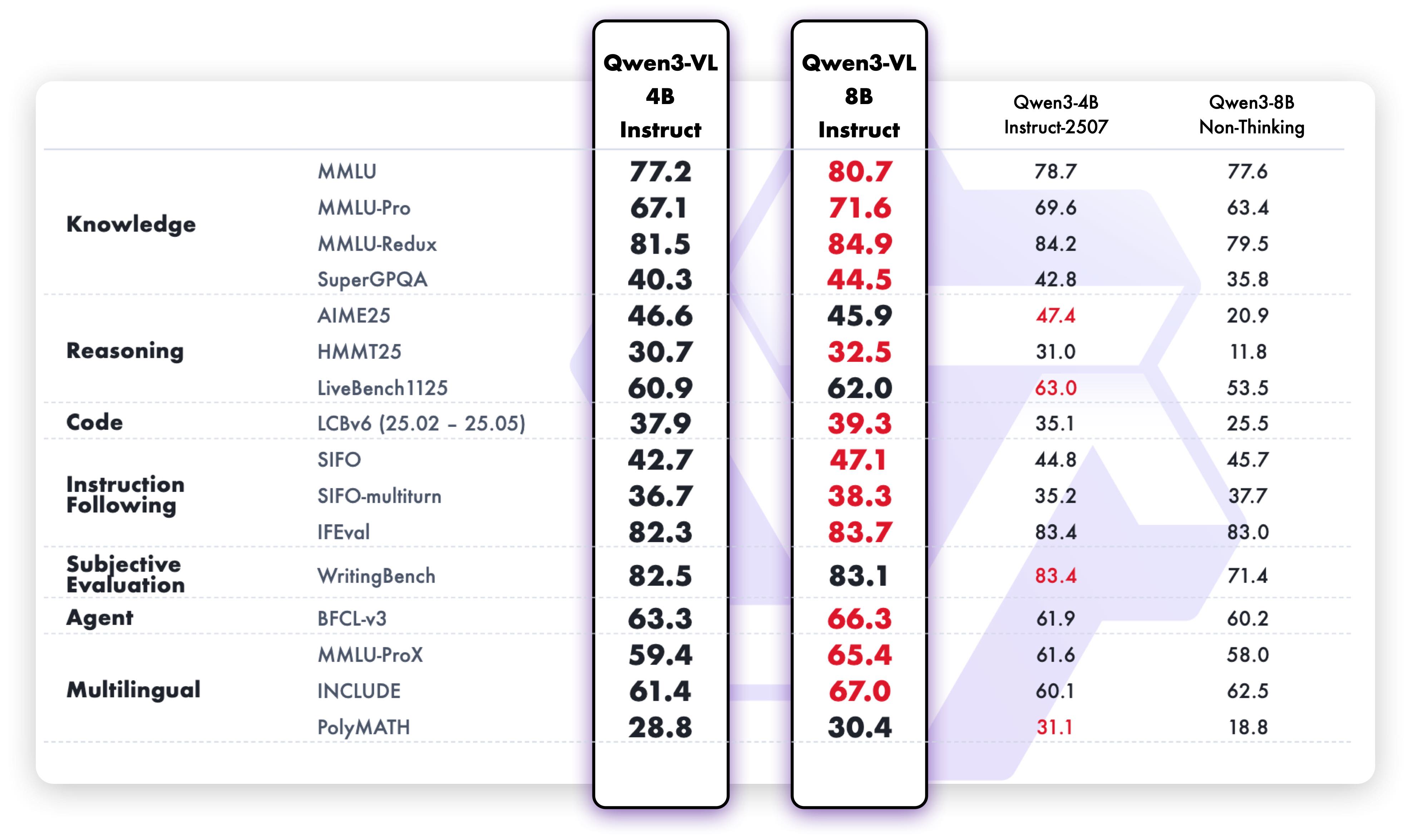

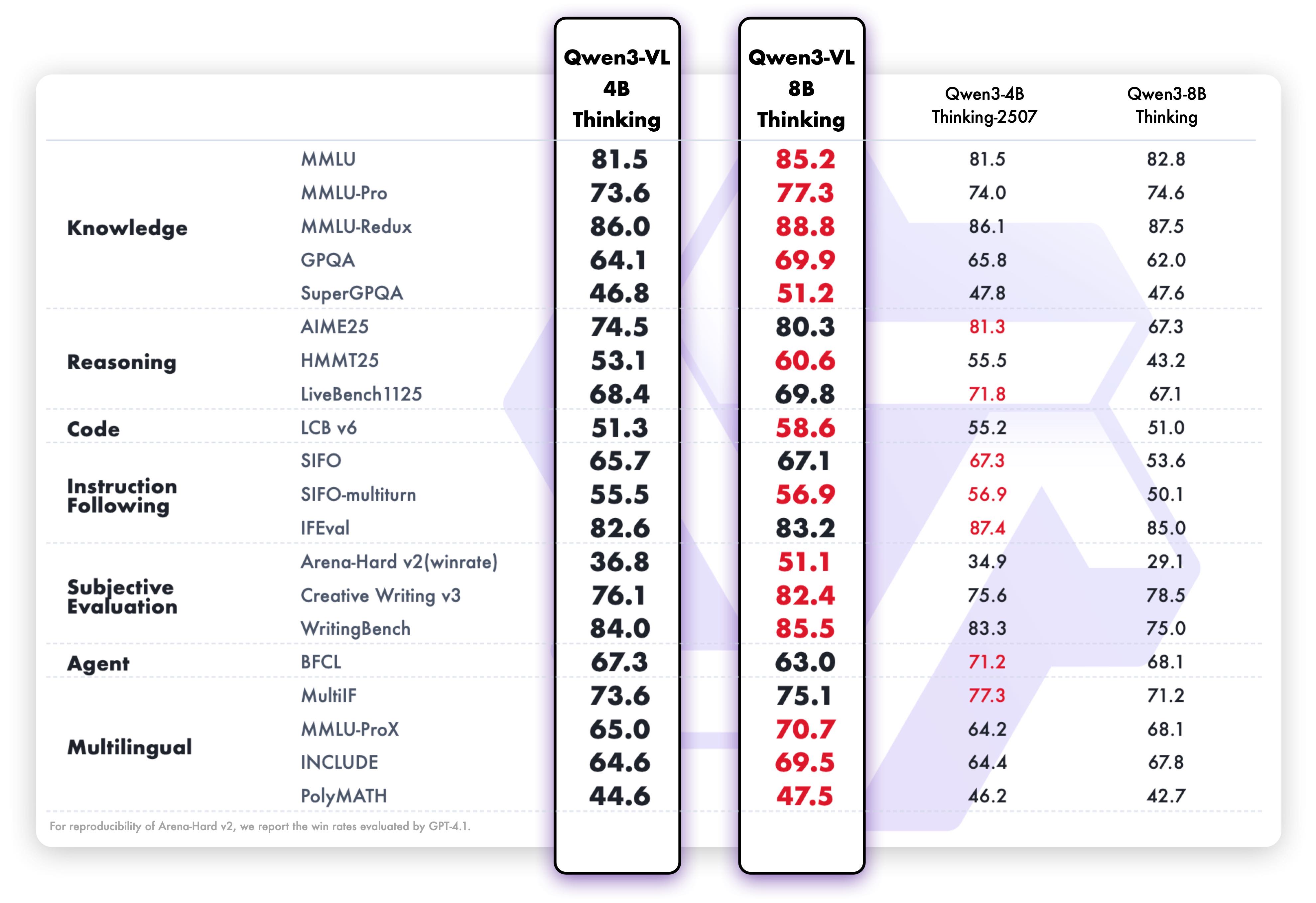

## 性能

### 视觉任务

### 文本中心任务

## Cookbooks

我们正在为多种能力准备 [cookbooks](https://github.com/QwenLM/Qwen3-VL/tree/main/cookbooks),包括识别、定位、文档解析、视频理解、关键信息提取等。欢迎了解更多!

| Cookbook | 描述 | 在线运行 |

| -------- | ----------- | ---- |

| [全能识别](https://github.com/QwenLM/Qwen3-VL/blob/main/cookbooks/omni_recognition.ipynb) | 不仅能识别动物、植物、人物和风景,还能识别汽车、商品等各种物体。 | [](https://colab.research.google.com/github/QwenLM/Qwen3-VL/blob/main/cookbooks/omni_recognition.ipynb) |

| [强大的文档解析能力](https://github.com/QwenLM/Qwen3-VL/blob/main/cookbooks/document_parsing.ipynb) | 文档解析达到更高水平,不仅包括文本,还包括布局位置信息和我们的 Qwen HTML 格式。 | [](https://colab.research.google.com/github/QwenLM/Qwen3-VL/blob/main/cookbooks/document_parsing.ipynb) |

| [跨格式的精确物体定位](https://github.com/QwenLM/Qwen3-VL/blob/main/cookbooks/2d_grounding.ipynb) | 使用相对位置坐标,支持框和点,允许定位和标注任务的多样化组合。 | [](https://colab.research.google.com/github/QwenLM/Qwen3-VL/blob/main/cookbooks/2d_grounding.ipynb) |

| [通用 OCR 和关键信息提取](https://github.com/QwenLM/Qwen3-VL/blob/main/cookbooks/ocr.ipynb) | 在自然场景和多种语言中更强的文本识别能力,支持多样化的关键信息提取需求。 | [](https://colab.research.google.com/github/QwenLM/Qwen3-VL/blob/main/cookbooks/ocr.ipynb) |

| [视频理解](https://github.com/QwenLM/Qwen3-VL/blob/main/cookbooks/video_understanding.ipynb) | 更好的视频 OCR、长视频理解和视频定位。 | [](https://colab.research.google.com/github/QwenLM/Qwen3-VL/blob/main/cookbooks/video_understanding.ipynb) |

| [移动端智能体](https://github.com/QwenLM/Qwen3-VL/blob/main/cookbooks/mobile_agent.ipynb) | 为手机控制进行定位和思考。 | [](https://colab.research.google.com/github/QwenLM/Qwen3-VL/blob/main/cookbooks/mobile_agent.ipynb) |

| [计算机使用智能体](https://github.com/QwenLM/Qwen3-VL/blob/main/cookbooks/computer_use.ipynb) | 为控制计算机和 Web 进行定位和思考。 | [](https://colab.research.google.com/github/QwenLM/Qwen3-VL/blob/main/cookbooks/computer_use.ipynb) |

| [3D 定位](https://github.com/QwenLM/Qwen3-VL/blob/main/cookbooks/3d_grounding.ipynb) | 为室内外物体提供精确的 3D 边界框。 | [](https://colab.research.google.com/github/QwenLM/Qwen3-VL/blob/main/cookbooks/3d_grounding.ipynb) |

| [图像思考](https://github.com/QwenLM/Qwen3-VL/blob/main/cookbooks/think_with_images.ipynb) | 利用 `image_zoom_in_tool` 和 `search_tool` 促进模型对图像中细粒度视觉细节的精确理解。 | [](https://colab.research.google.com/github/QwenLM/Qwen3-VL/blob/main/cookbooks/think_with_images.ipynb) |

| [多模态编码](https://github.com/QwenLM/Qwen3-VL/blob/main/cookbooks/mmcode.ipynb) | 基于对多模态信息的严谨理解生成准确的代码。 | [](https://colab.research