dotagent 支持云端与多设备部署的跨平台智能体框架

armed · 2026-03-26 21:21:07 · 30 次点击 · 0 条评论[!NOTE]

你好,朋友!

这个项目目前仍处于“仅供朋友体验”的阶段。如果你想看看我们在捣鼓什么,并且有些想法,不妨看看代码。我们非常欢迎你的反馈或贡献。

Nextpy 是什么?

Nextpy 是一个用于构建自修改软件的框架。

核心特性

🚧 安全护栏

- 设定清晰边界: 用户可以精确定义 AI 系统能做什么和不能做什么。这一保障措施确保 AI 系统在保持动态、自我改进的同时,不会超越既定限制。

🏗️ 通过结构化输出实现更强控制

-

比链式调用或提示更有效: 提示引擎解锁了提示工程的下一层级,与少样本提示或传统的链式方法相比,提供了对 LLM 显著更强的控制力。

-

赋予提示工程师超能力: 它赋予了提示工程的全部力量,与 LLM 实际处理文本的方式保持一致。这种理解使你能够精确控制输出,定义确切的响应结构,并指导 LLM 如何生成响应。

🏭 强大的提示引擎

其理念是在编译时处理更多逻辑,并与 LLM 保持更好的会话状态。

-

预编译提示: 通过在编译时处理基本的提示逻辑,消除了不必要的冗余 LLM 处理。

-

与 LLM 的会话状态: 与 LLM 保持状态并复用 KV 缓存,可以消除许多冗余生成,并显著加速处理更长、更复杂的提示。(仅适用于开源模型)

-

优化的 Token: 引擎可以将许多输出 token 转换为提示 token 批次,后者更便宜、更快。模板的结构可以动态引导后续 token 的概率,确保与模板对齐并优化 token 化。(仅适用于开源模型)

-

推测采样(开发中): 你可以通过使用一个较小的模型作为助手,来提升大型语言模型的 token 生成速度。该方法依赖于一种算法,该算法使用更快的草稿模型,在每次 transformer 调用时生成多个 token。这可以将 token 生成速度提升高达 3 倍。

🤖 更优的 AI 生成:

-

🧠 比链式调用或提示工程更有效 - Next.py 与 LLM 处理模式保持一致,实现了精确的输出控制和最优的模型利用率。

-

💡 为代码生成优化 - 无论使用何种 LLM、提示或微调,底层的应用框架都会显著影响代码生成的效率。Next.py 的架构是专门为最大化效率而设计的。

-

💾 与 LLM 的会话状态 - 高效地与 LLM 保持状态,利用 KV 缓存将多个输出 token 转换为提示 token 批次。这种方法减少了冗余生成,加速了对冗长复杂提示的处理。(仅适用于开源模型)

-

🧪 检测语法错误:测试 LLM 生成的代码,识别并纠正 LLM 幻觉、无效的 Nextpy 方法,并自动生成提示以进行无缝修复。

🧱 模块化

-

多平台: AI 系统不必在单一位置或机器上运行。不同的组件可以跨各种平台运行,包括云端、个人电脑或移动设备。

-

可扩展: 如果你知道如何用 Python 或纯英文做某事,你就可以将其与 Nextpy 集成。

❤️ 开发者优先:❤️

- 📘 可迁移的知识 - 学习 Next.py 可以教会你与框架无关的基础知识和最佳的 Python 库,提升你的 Python 开发专业技能,并使你能够在任何框架中表现出色。

📦 容器化与可扩展

-

.🤖 文件: 底层智能体可以轻松导出为简单的

.agent或.🤖文件,使其能够在任何环境中运行。 -

Agentbox(可选): AI 系统应能够在沙盒内优化计算资源。你可以通过简单的 API 在本地或云端使用 Agentbox,云端 Agentbox 提供额外的控制和安全保障。

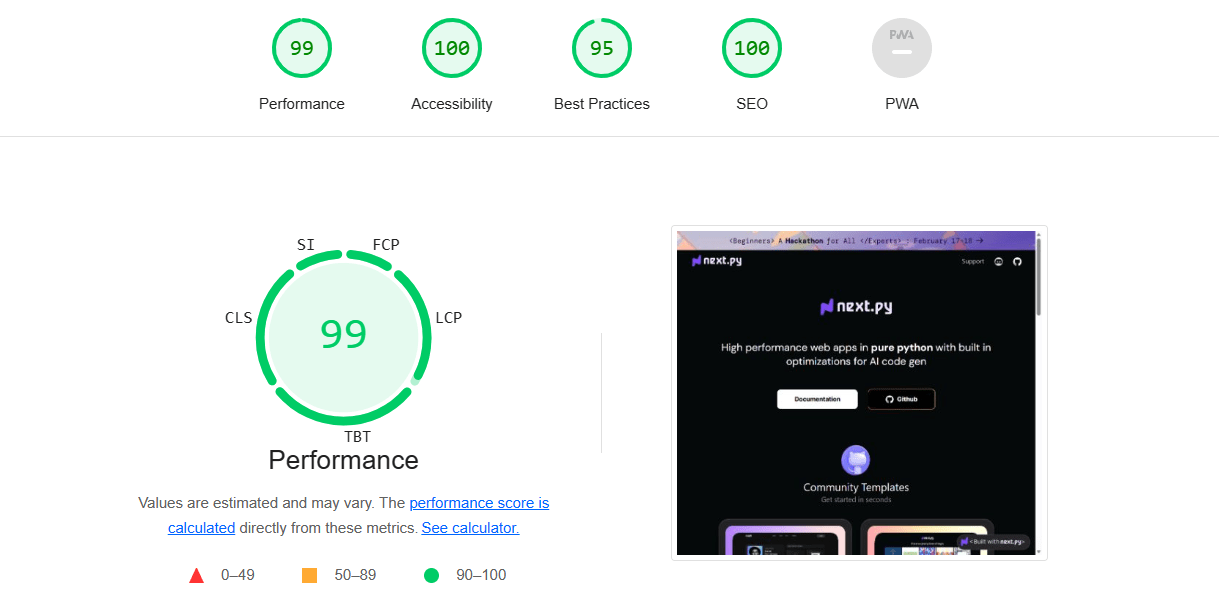

性能

- ⚡ 比你的 Streamlit 应用快 4-10 倍: 我们编译后的软件相比 Streamlit 实现了惊人的 4-10 倍性能飞跃。在 nextpy.org 上亲眼见证差异,其 PageSpeed 得分高达 99/100。

🙏 致谢

NextPy 框架是一个为基于 AI 的代码生成优化的尖端软件开发框架,建立在开源社区合作精神之上。它无缝集成了来自 Guidance、DSPy、Llama-Index、FastAPI-Mail、LangChain、ReactPy、Reflex、Chakra、Radix、NumPy 和 Next.js 等标志性项目的关键组件,同时也借鉴了 React 和 Rust 生态系统的见解。

其中一个有趣的模块是生成式 UI 模块,它目前使用了 Reflex、Reacton 和 Solara 的分支版本。

我们衷心感谢那些为 NextPy 奠定基础的开源创作者、贡献者和维护者。你们对创新和开放的承诺对于塑造这个框架至关重要。你们的贡献不仅增强了 NextPy,也正在推动 AI 驱动软件开发的新时代。感谢你们成为这场变革之旅的催化剂和推动者。