Visionatrix — 围绕 ComfyUI 的可视化 AI 图像工作台

root · 2026-03-30 11:00:28 · 31 次点击 · 0 条评论此仓库已归档

我们感谢每一位参与这段旅程的人。

遗憾的是,我们已无力继续开发此项目,它现已进入归档状态。

Visionatrix

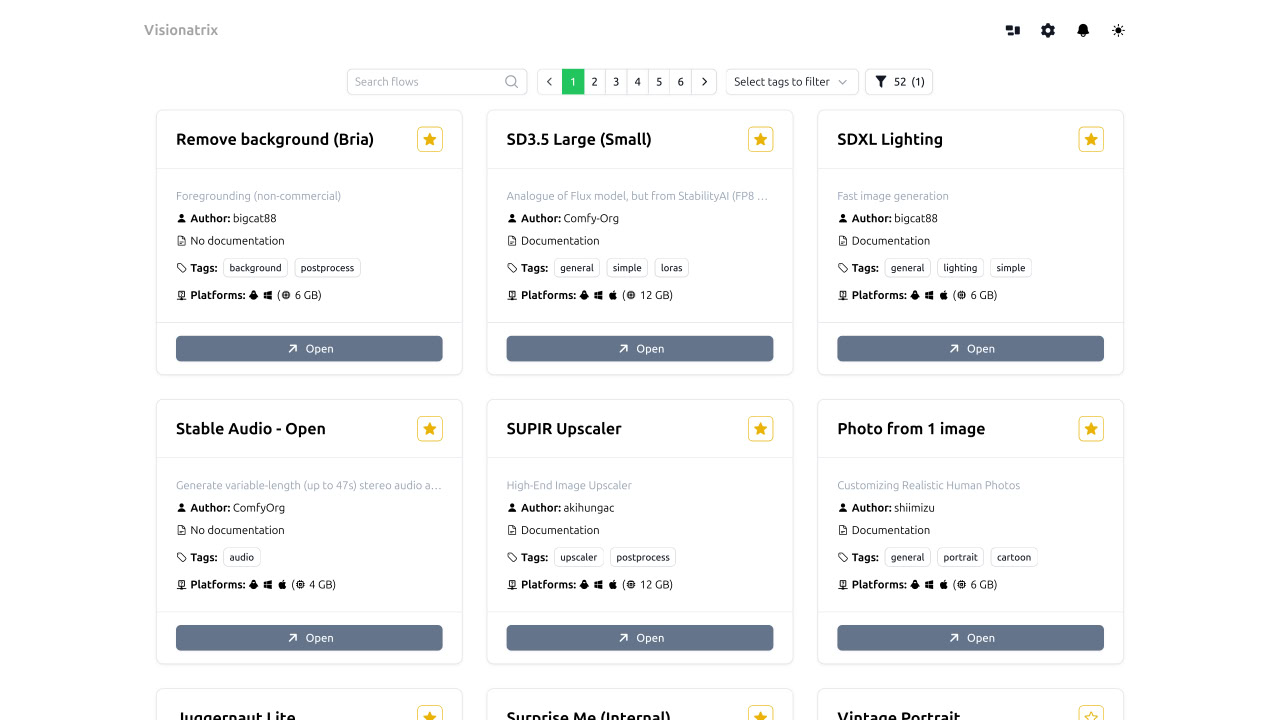

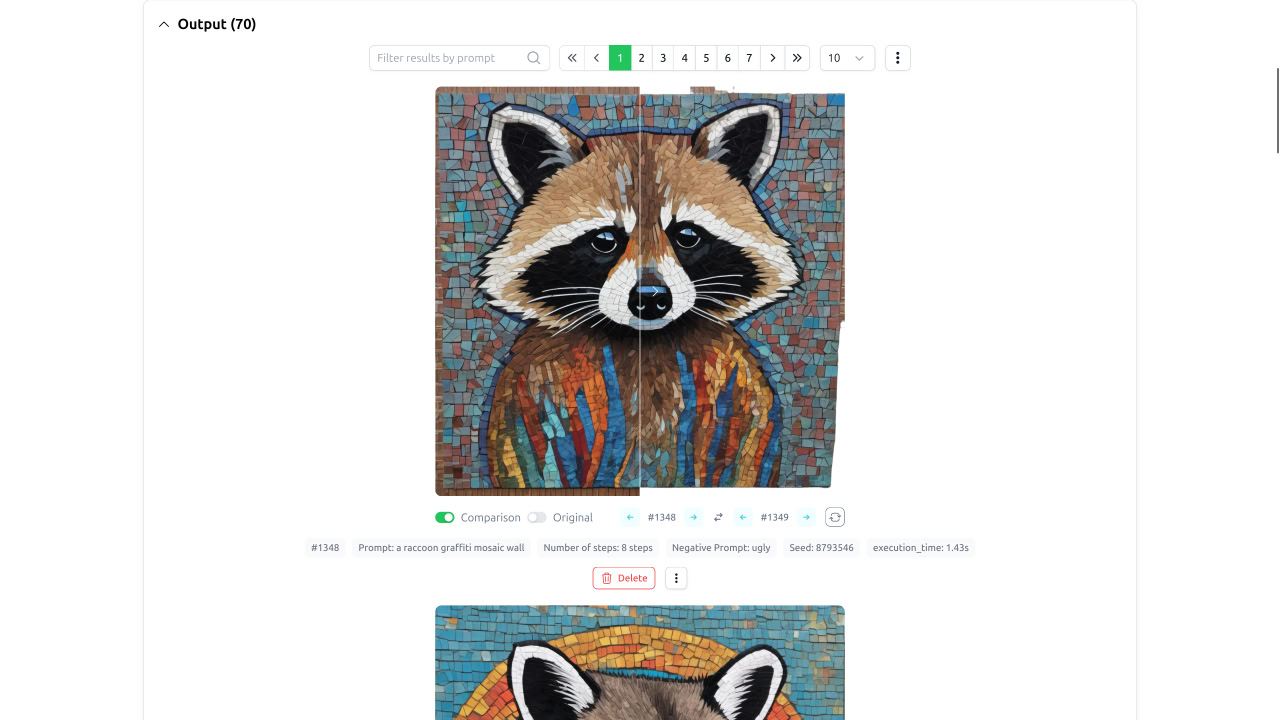

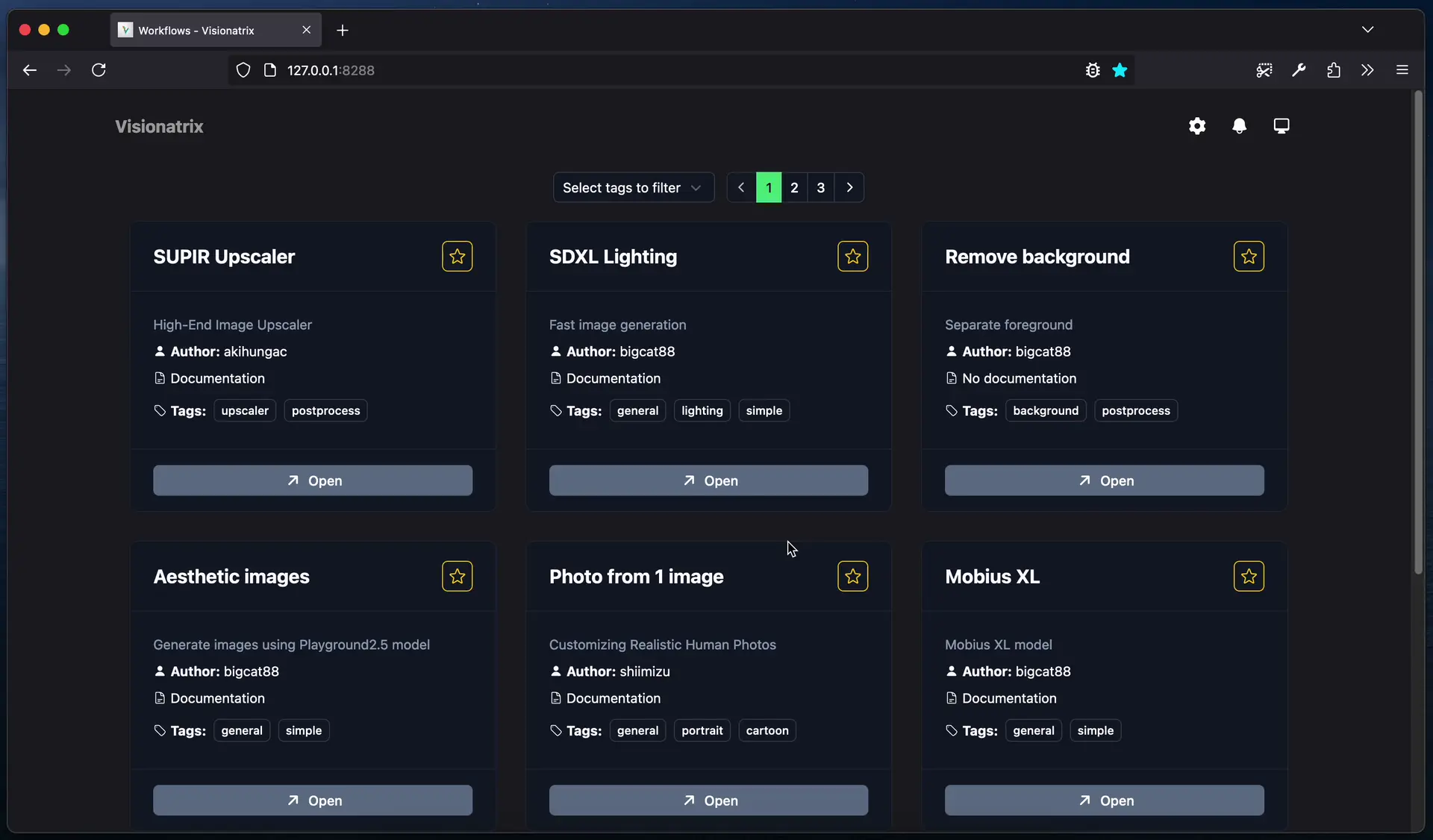

Visionatrix——一个构建于 ComfyUI 之上的直观界面,助您简化 AI 媒体生成工作流。

🚀 特性

- 🔧 简易安装与更新:简单安装,轻松实现版本更新。

- 🖥️ 简约 UI:专为日常使用设计的简洁、用户友好界面。

- 🌐 提示词翻译支持:自动翻译用于媒体生成的提示词。

- 🛠️ 稳定工作流:版本化且可升级的工作流。

- 📈 可扩展性:运行多个实例,支持同时处理任务,提升生产力。

- 👥 多用户支持:轻松配置多用户,并集成不同的用户后端。

- 🤖 LLM 集成:轻松将 Ollama/Gemini 作为 LLM 集成到 ComfyUI 工作流中。

- 🔌 无缝集成:作为服务运行,提供后端端点,便于项目平滑集成。

- 😎 LoRA 集成:轻松将 CivitAI 的 LoRA 集成到您的流程中。

- 🐳 Docker Compose:提供官方 Docker 镜像和预配置的 Docker Compose 文件。

🖼️ 用户界面

默认情况下,在 http://localhost:8288 访问 Visionatrix UI。

注意: 从 1.10 版本开始,Visionatrix 在 http://127.0.0.1:8188 启动 ComfyUI 网络服务器。

📹 点击查看简短演示视频

📥 安装

我们提供了 RunPOD 公共模板,帮助您快速了解此项目是否符合您的需求。

要求

- Python

3.10或更高版本。(推荐3.12) - GPU 内存至少

8 GB(推荐 12GB)

快速开始 (Linux/macOS/WSL)

安装先决条件 (Python, Git 等)

对于 Ubuntu 22.04: ```bash sudo apt install wget curl python3-venv python3-pip build-essential git ``` 也建议安装 FFMpeg 依赖: ```bash sudo apt install ffmpeg libsm6 libxext6 ```下载并运行 easy_install.py 脚本:

注意: 此脚本会将 Visionatrix 仓库克隆到当前文件夹并执行安装。安装后,您始终可以从 "scripts" 文件夹运行

easy_install。

使用 wget:

wget -O easy_install.py https://raw.githubusercontent.com/Visionatrix/Visionatrix/main/scripts/easy_install.py && python3 easy_install.py

使用 curl:

curl -o easy_install.py https://raw.githubusercontent.com/Visionatrix/Visionatrix/main/scripts/easy_install.py && python3 easy_install.py

按照安装过程中的提示操作。在大多数情况下,一切都会顺利进行。

要启动 Visionatrix,请在激活的虚拟环境中运行:

python -m visionatrix run --ui

快速开始 (Windows)

我们提供便携版本以简化安装(无需 Git 或 Visual Studio 编译器)。

目前,我们提供 CUDA/CPU 版本。如有需求,我们可以添加 DirectML 版本。

- 安装 VC++ 可再发行组件:从 Microsoft 页面 下载 vc_redist.x64.exe。

- 下载:访问我们的 发布页面。

- 获取便携版压缩包:下载

vix_portable_cuda.7z。 - 解压并运行:解压压缩包,然后运行

run_nvidia_gpu.bat或run_cpu.bat。

手动安装

有关手动安装步骤,请参阅我们的 详细文档。

⚙️ 安装后配置

路径配置

设置路径最简单的方法是通过用户界面,前往 设置->ComfyUI。

在大多数情况下,最简单的方法是将 ComfyUI 基础数据文件夹 设置为某个绝对路径,用于存储模型、任务结果和设置。

这将允许您自由地从头重新安装所有内容,而不会丢失数据或模型。

注意: 为了便于 Windows 便携版升级,我们假设您已设置

ComfyUI 基础数据文件夹参数。

HuggingFace 和 CivitAI 令牌

我们强烈建议在设置中填写

CivitAI 令牌和

HuggingFace 令牌。

许多模型没有令牌无法被公共用户下载。

🔄 更新 Visionatrix

对于 Linux/macOS

运行 easy_install 脚本并选择 "更新" 选项。

python3 easy_install.py

对于 Windows (便携版本)

更新便携版本涉及:

- 解压新的便携版本。

- 将

visionatrix.db从旧版本移动到新版本。

提示

或者,您可以使用 `DATABASE_URI` 环境变量为 `visionatrix.db` 指定自定义路径。这允许您将数据库文件保留在便携压缩包之外,从而**跳过步骤 2**。 例如,将 DATABASE_URI 设置为: `sqlite+aiosqlite:///C:/Users/alex/visionatrix.db` 将指示 Visionatrix 使用 `C:\Users\alex\visionatrix.db` 文件。Docker Compose

我们提供官方 Docker 镜像以及预配置的 docker-compose.yml 文件,使部署更快更容易。该文件位于 Visionatrix 仓库的根目录。

镜像仓库

我们的 Docker 镜像主要托管在 GitHub 容器注册表 (GHCR):ghcr.io/visionatrix/visionatrix。这是 docker-compose.yml 文件使用的默认仓库。

对于从 GHCR 下载速度较慢的用户(例如,在某些云提供商上),我们还在 Docker Hub 上提供了镜像:docker.io/bigcat88/visionatrix。

可用服务

- visionatrix_nvidia:支持

NVIDIA GPU的 Visionatrix。 - visionatrix_amd:支持

AMD GPU的 Visionatrix。 - visionatrix_cpu:仅运行在

CPU上的 Visionatrix。 - pgsql:用于数据库的 PostgreSQL 17 容器。

使用方法

根据您的硬件选择适当的服务:

-

对于 NVIDIA GPU 支持:

bash docker compose up -d visionatrix_nvidia -

对于 AMD GPU 支持:

bash docker compose up -d visionatrix_amd -

对于 CPU 模式:

bash docker compose up -d visionatrix_cpu

默认情况下,这些命令将从 GHCR 拉取镜像。将在主机当前目录中创建 visionatrix-data 目录,用于存放 models、user、input 和 output 文件。

您可以通过修改 docker-compose.yml 文件中的环境变量或卷挂载来轻松自定义配置。

使用 Docker Hub 镜像

如果您希望从 Docker Hub 而不是 GHCR 拉取镜像,可以在运行 docker compose up 之前 设置 VIX_IMAGE_BASE 环境变量。

方法 1:使用 .env 文件

- 在与您的

docker-compose.yml文件相同的目录中创建一个名为.env的文件。 -

在

.env文件中添加以下行:dotenv VIX_IMAGE_BASE=docker.io/bigcat88/visionatrix -

现在,像往常一样运行

docker compose up。Compose 将自动读取.env文件并使用 Docker Hub 镜像。```bash

示例:使用 .env 中定义的 Docker Hub 镜像启动 NVIDIA 服务

docker compose up -d visionatrix_nvidia

```

方法 2:临时设置变量

您可以在命令行上直接设置环境变量,用于单次命令执行:

VIX_IMAGE_BASE=docker.io/bigcat88/visionatrix docker compose up -d visionatrix_nvidia

自行构建

-

从此仓库的根目录构建新镜像,使用以下参数:

- BUILD_TYPE (必需):定义构建类型:

cpu、cuda或rocm - CUDA_VERSION (可选):定义您要使用的 pytorch CUDA 版本(例如,126 表示 12.6)。默认是 12.8,不支持旧显卡。

使用 12.6 CUDA 版本构建 cuda 镜像的示例:

docker build --build-arg BUILD_TYPE=cuda --build-arg CUDA_VERSION=126 visionatrix:release-cuda12.6 -f docker/Dockerfile .

2. 启动引用新镜像的服务:

VIX_IMAGE_BASE=visionatrix:release-cuda12.6 docker compose up -d visionatrix_nvidia - BUILD_TYPE (必需):定义构建类型:

📚 文档与支持

如果您有任何问题或需要帮助,我们随时为您服务!欢迎随时 发起讨论 或探索我们的资源: